Cuantifique el valor de Netskope One SSE: obtenga el estudio de impacto™ económico total de Forrester de 2024

-

Por qué Netskope

- Por qué Netskope

Por qué Netskope

Cambiar la forma en que las redes y la seguridad trabajan juntas.

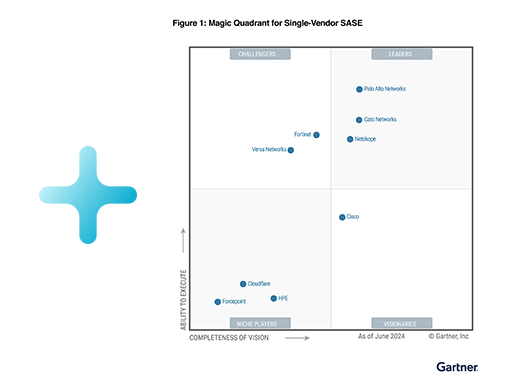

Obtenga el informeLíder en SSE. Ahora es líder en SASE de un solo proveedor.Descubre por qué Netskope debutó como Líder en el Cuadrante Mágico de Gartner® 2024 para Secure Access Service Edge (SASE) de Proveedor Único.

- Por qué Netskope

Nuestros clientes

Netskope atiende a más de 3.400 clientes en todo el mundo, incluidos más de 30 de las 100 empresas más importantes de Fortune

Obtenga el eBookTestimonios de ClientesLea cómo los clientes innovadores navegan con éxito por el cambiante panorama actual de las redes y la seguridad a través de la Plataforma Netskope One.

- Por qué Netskope

Nuestros Partners

Nos asociamos con líderes en seguridad para ayudarlo a asegurar su viaje a la nube.

Más información sobre los socios de NetskopeLa estrategia de venta centrada en el partner de Netskope permite a nuestros canales maximizar su expansión y rentabilidad y, al mismo tiempo, transformar la seguridad de su empresa.

-

Plataforma

- Plataforma

Plataforma Netskope One

Netskope One es una Plataforma convergente de seguridad y red como servicio.

Obtenga el whitepaperTu red del mañanaPlanifique su camino hacia una red más rápida, más segura y más resistente diseñada para las aplicaciones y los usuarios a los que da soporte.

- Plataforma

Partners tecnológicos e integraciones

Netskope colabora con las empresas más punteras en tecnología empresarial.

Más información sobre Cloud ExchangeNetskope Cloud ExchangeCloud Exchange (CE) de Netskope ofrece a sus clientes herramientas de integración eficaces para que saquen partido a su inversión en estrategias de seguridad.

-

Productos

- Productos

Security Service Edge

Protéjase contra las amenazas avanzadas y en la nube y salvaguarde los datos en todos los vectores.

Todos los productosLa plataforma del futuro es NetskopeSecurity Service Edge (SSE), Cloud Access Security Broker (CASB), Cloud Firewall, Next Generation Secure Web Gateway (SWG) y Private Access for ZTNA integrados de forma nativa en una única solución para ayudar a todas las empresas en su viaje hacia la arquitectura Secure Access Service Edge (SASE).

- Security service edge (SSE)

- Next Gen Secure Web Gateway (SWG)

- Cortafuegos (FWaaS)

- Remote Browser Isolation (RBI)

- Cloud Access Security Broker (CASB)

- SaaS security posture management (SSPM)

- Acceso privado

- Prevención de pérdida de datos (DLP)

- Gestión de la postura de seguridad de los datos (DSPM)

- Inteligencia de dispositivos

- Protección contra Amenazas

- Security service edge (SSE)

- Productos

SD-WAN

Proporcione con confianza un acceso seguro y de alto rendimiento a cada usuario remoto, dispositivo, sitio y nube.

Obtenga más información sobre Next Gen SASE BranchNext Gen SASE Branch es híbrida: conectada, segura y automatizadaNetskope Next Gen SASE Branch converge Context-Aware SASE Fabric, Zero-Trust Hybrid Security y SkopeAI-Powered Cloud Orchestrator en una oferta de nube unificada, marcando el comienzo de una experiencia de sucursal completamente modernizada para la empresa sin fronteras.

- Productos

Secure Access Service Edge

Netskope One SASE proporciona una solución SASE nativa en la nube, totalmente convergente y de un único proveedor.

Obtenga el eBookArquitectura SASE para principiantesObtenga un ejemplar gratuito del único manual que necesitará sobre diseño de una arquitectura SASE.

-

Soluciones

- Soluciones

Transformación de la red

Logre agilidad y eficiencia a través de la transformación digital.

Ir a Soluciones Resumen generalMás información sobre NewEdgeCambie a los servicios de seguridad en la nube líderes del mercado con una latencia mínima y una alta fiabilidad. - Soluciones

Modernización de la seguridad

Enfrente los desafíos de seguridad de hoy y de mañana.

Descubra cómo aseguramos el uso generativo de IAHabilite de forma segura el uso de aplicaciones de IA generativa con control de acceso a aplicaciones, capacitación de usuarios en tiempo real y la mejor protección de datos de su clase.- Protección Avanzada contra Amenazas

- Protección de datos

- Trabajo híbrido

- Riesgo interno

- Mantener el cumplimiento

- Reemplazar VPN

- Habilite de forma segura ChatGPT y IA generativa

- Protección de Aplicaciones Cloud Gestionadas

- Protección de Aplicaciones Cloud No Gestionadas

- AWS, Azure y GCP

- Protección Avanzada contra Amenazas

- Soluciones

Marcos

Adopte los marcos regulatorios que dan forma a la ciberseguridad.

Ir a Soluciones Resumen generalMás información sobre Confianza CeroSoluciones de confianza cero para implementaciones de SSE y SASE - Soluciones

Gobierno e Industrias

Netskope ayuda a las agencias y empresas más grandes del mundo a asegurar su viaje a la nube.

Más información sobre Netskope GovCloudNetskope logra la alta autorización FedRAMPElija Netskope GovCloud para acelerar la transformación de su agencia.

-

Recursos

- Recursos

Recursos

Obtenga más información sobre cómo Netskope puede ayudarle a proteger su viaje hacia la nube.

Reproducir el pódcast Ver todos los podcastsPodcast Security VisionariesNavegando por la soberanía de los datos

Max Havey conversa con Michael Dickerson, CEO de TSC Global y fundador de Dickerson Digital, sobre el tema crítico de la soberanía de los datos. - Recursos

Blog

Descubra cómo Netskope permite la transformación de la seguridad y las redes a través del perímetro de servicio de acceso seguro (SASE)

Lea el blogÚltimos blogsLea cómo Netskope puede habilitar el viaje hacia Zero Trust y SASE a través de las capacidades de perímetro de servicio de acceso seguro (SASE).

- Recursos

Eventos y Talleres

Manténgase a la vanguardia de las últimas tendencias de seguridad y conéctese con sus pares.

Explorar sesionesSASE Week 2024 bajo demandaAprenda a navegar por los últimos avances en SASE y Zero Trust y explore cómo estos marcos se están adaptando para abordar los desafíos de ciberseguridad e infraestructura

- Recursos

Seguridad definida

Todo lo que necesitas saber en nuestra enciclopedia de ciberseguridad.

Conozca el SASE¿Qué es SASE?Infórmese sobre la futura convergencia de las herramientas de red y seguridad en el modelo de negocio actual de la nube.

- Descripción general de la seguridad definida

- ¿Qué es SASE?

- ¿Qué es Security Service Edge (SSE)?

- ¿Qué es un Cloud Access Security Broker (CASB)?

- ¿Qué es el acceso a la red Zero Trust (ZTNA)?

- ¿Qué es Next Generation Secure Web Gateway (SWG)?

- ¿Qué es Data Loss Prevention (DLP)?

- ¿Qué es SD-WAN?

- ¿Qué es la IA generativa?

- ¿Qué es SSPM?

- ¿Qué es FedRamp?

- Descripción general de la seguridad definida

-

Empresa

- Empresa

Empresa

Le ayudamos a mantenerse a la vanguardia de los desafíos de seguridad de la nube, los datos y la red.

Descubra másApoyar la sostenibilidad a través de la seguridad de los datosNetskope se enorgullece de participar en Vision 2045: una iniciativa destinada a crear conciencia sobre el papel de la industria privada en la sostenibilidad.

- Empresa

Ofertas de Trabajo

Únase a los +3,000 increíbles miembros del equipo de Netskopeque construyen la plataforma de seguridad nativa en la nube líder en el sector.

Únete al equipoAyude a dar forma al futuro de la seguridad en la nubeEn Netskope, los fundadores y líderes trabajan codo con codo con sus colegas, incluso los expertos más renombrados dejan sus egos en la puerta y las mejores ideas ganan.

- Empresa

Soluciones para clientes

Le apoyamos en cada paso del camino, garantizando su éxito con Netskope.

Ir a Soluciones para clientesNetskope profesionales dedicados al servicio y al soporte le garantizarán una implementación exitosa y experimentarán todo el valor de nuestra plataforma.- Servicios Profesionales

- Satisfacción de los Clientes

- Soporte técnico

- Socios en la prestación de servicios

- Comunidad de clientes

- Documentación del producto

- Support Portal

- Trust Portal

- Servicios Profesionales

- Empresa

Formación y Acreditaciones

La formación de Netskope le ayudará a convertirse en un experto en seguridad en la nube.

Infórmese sobre Capacitaciones y CertificacionesAsegure su viaje de transformación digital y aproveche al máximo sus aplicaciones en la nube, web y privadas con la capacitación de Netskope.- Formación técnica en línea de introducción a Netskope Security Cloud

- Operación y administración de Netskope Security Cloud (NSCO&A)

- Implementación e integración de Netskope Security Cloud (NSCI&I)

- Formación técnica en línea de introducción a Netskope Security Cloud

- Por qué Netskope

Cambiar la forma en que las redes y la seguridad trabajan juntas.

- Nuestros clientes

Netskope atiende a más de 3.400 clientes en todo el mundo, incluidos más de 30 de las 100 empresas más importantes de Fortune

- Nuestros Partners

Nos asociamos con líderes en seguridad para ayudarlo a asegurar su viaje a la nube.

Descubre por qué Netskope debutó como Líder en el Cuadrante Mágico de Gartner® 2024 para Secure Access Service Edge (SASE) de Proveedor Único.

Obtenga el informe

Lea cómo los clientes innovadores navegan con éxito por el cambiante panorama actual de las redes y la seguridad a través de la Plataforma Netskope One.

Obtenga el eBook

- Plataforma Netskope One

Netskope One es una Plataforma convergente de seguridad y red como servicio.

- Partners tecnológicos e integraciones

Netskope colabora con las empresas más punteras en tecnología empresarial.

Planifique su camino hacia una red más rápida, más segura y más resistente diseñada para las aplicaciones y los usuarios a los que da soporte.

Obtenga el whitepaper

Cloud Exchange (CE) de Netskope ofrece a sus clientes herramientas de integración eficaces para que saquen partido a su inversión en estrategias de seguridad.

Más información sobre Cloud Exchange

- Security Service Edge

Protéjase contra las amenazas avanzadas y en la nube y salvaguarde los datos en todos los vectores.

- SD-WAN

Proporcione con confianza un acceso seguro y de alto rendimiento a cada usuario remoto, dispositivo, sitio y nube.

- Secure Access Service Edge

Netskope One SASE proporciona una solución SASE nativa en la nube, totalmente convergente y de un único proveedor.

- Security service edge (SSE)

- Next Gen Secure Web Gateway (SWG)

- Cortafuegos (FWaaS)

- Remote Browser Isolation (RBI)

- Cloud Access Security Broker (CASB)

- SaaS security posture management (SSPM)

- Acceso privado

- Prevención de pérdida de datos (DLP)

- Gestión de la postura de seguridad de los datos (DSPM)

- Inteligencia de dispositivos

- Protección contra Amenazas

Security Service Edge (SSE), Cloud Access Security Broker (CASB), Cloud Firewall, Next Generation Secure Web Gateway (SWG) y Private Access for ZTNA integrados de forma nativa en una única solución para ayudar a todas las empresas en su viaje hacia la arquitectura Secure Access Service Edge (SASE).

Todos los productos

Netskope Next Gen SASE Branch converge Context-Aware SASE Fabric, Zero-Trust Hybrid Security y SkopeAI-Powered Cloud Orchestrator en una oferta de nube unificada, marcando el comienzo de una experiencia de sucursal completamente modernizada para la empresa sin fronteras.

Obtenga más información sobre Next Gen SASE Branch

Obtenga un ejemplar gratuito del único manual que necesitará sobre diseño de una arquitectura SASE.

Obtenga el eBook

- Transformación de la red

Logre agilidad y eficiencia a través de la transformación digital.

- Modernización de la seguridad

Enfrente los desafíos de seguridad de hoy y de mañana.

- Marcos

Adopte los marcos regulatorios que dan forma a la ciberseguridad.

- Gobierno e Industrias

Netskope ayuda a las agencias y empresas más grandes del mundo a asegurar su viaje a la nube.

- Protección Avanzada contra Amenazas

- Protección de datos

- Trabajo híbrido

- Riesgo interno

- Mantener el cumplimiento

- Reemplazar VPN

- Habilite de forma segura ChatGPT y IA generativa

- Protección de Aplicaciones Cloud Gestionadas

- Protección de Aplicaciones Cloud No Gestionadas

- AWS, Azure y GCP

Elija Netskope GovCloud para acelerar la transformación de su agencia.

Más información sobre Netskope GovCloud

- Recursos

Obtenga más información sobre cómo Netskope puede ayudarle a proteger su viaje hacia la nube.

- Blog

Descubra cómo Netskope permite la transformación de la seguridad y las redes a través del perímetro de servicio de acceso seguro (SASE)

- Eventos y Talleres

Manténgase a la vanguardia de las últimas tendencias de seguridad y conéctese con sus pares.

- Seguridad definida

Todo lo que necesitas saber en nuestra enciclopedia de ciberseguridad.

- Descripción general de la seguridad definida

- ¿Qué es SASE?

- ¿Qué es Security Service Edge (SSE)?

- ¿Qué es un Cloud Access Security Broker (CASB)?

- ¿Qué es el acceso a la red Zero Trust (ZTNA)?

- ¿Qué es Next Generation Secure Web Gateway (SWG)?

- ¿Qué es Data Loss Prevention (DLP)?

- ¿Qué es SD-WAN?

- ¿Qué es la IA generativa?

- ¿Qué es SSPM?

- ¿Qué es FedRamp?

Navegando por la soberanía de los datos

Max Havey conversa con Michael Dickerson, CEO de TSC Global y fundador de Dickerson Digital, sobre el tema crítico de la soberanía de los datos.

Lea cómo Netskope puede habilitar el viaje hacia Zero Trust y SASE a través de las capacidades de perímetro de servicio de acceso seguro (SASE).

Lea el blog

Aprenda a navegar por los últimos avances en SASE y Zero Trust y explore cómo estos marcos se están adaptando para abordar los desafíos de ciberseguridad e infraestructura

Explorar sesiones

Infórmese sobre la futura convergencia de las herramientas de red y seguridad en el modelo de negocio actual de la nube.

Conozca el SASE

- Empresa

Le ayudamos a mantenerse a la vanguardia de los desafíos de seguridad de la nube, los datos y la red.

- Ofertas de Trabajo

Únase a los +3,000 increíbles miembros del equipo de Netskopeque construyen la plataforma de seguridad nativa en la nube líder en el sector.

- Soluciones para clientes

Le apoyamos en cada paso del camino, garantizando su éxito con Netskope.

- Formación y Acreditaciones

La formación de Netskope le ayudará a convertirse en un experto en seguridad en la nube.

Netskope se enorgullece de participar en Vision 2045: una iniciativa destinada a crear conciencia sobre el papel de la industria privada en la sostenibilidad.

Descubra más

En Netskope, los fundadores y líderes trabajan codo con codo con sus colegas, incluso los expertos más renombrados dejan sus egos en la puerta y las mejores ideas ganan.

Únete al equipo

)

)

Lea el blog

Lea el blog