El Informe sobre Nube y Amenazas en las aplicaciones de IA de este año se centra específicamente en las tendencias y riesgos de las aplicaciones genAI, ya que su uso ha crecido rápidamente con un amplio alcance y un gran impacto en los usuarios empresariales. El 96% de las organizaciones encuestadas tienen usuarios que utilizan genAI y el número de usuarios se ha triplicado en los últimos 12 meses. El uso en el mundo real de las aplicaciones genAI incluye ayuda con la codificación, asistencia para la escritura, creación de presentaciones y generación de videos e imágenes. Estos casos de uso plantean retos de seguridad de los datos, en concreto cómo evitar que los datos sensibles, como el código fuente, los datos regulados y la propiedad intelectual, se envíen a aplicaciones no aprobadas.

Comenzamos este Informe examinando las tendencias de uso de las aplicaciones genAI, después analizamos los riesgos generales que introduce el uso de genAI, discutimos los controles específicos que son eficaces y pueden ayudar a la Organización a mejorar frente a datos incompletos o nuevas áreas de amenaza, y terminamos con una mirada a las tendencias e implicaciones futuras.

Sobre la base de millones de actividades anónimas de los usuarios, el uso de la aplicación genAI ha experimentado cambios significativos desde junio de 2023 hasta junio de 2024:

- Prácticamente todas las organizaciones utilizan ahora aplicaciones genAI, y su uso ha aumentado del 74% al 96% de las organizaciones en el último año.

- La adopción de GenAI está creciendo rápidamente y aún no ha alcanzado un estado estable. La Organización media utiliza más del triple de aplicaciones genAI y tiene casi el triple de usuarios que utilizan activamente esas aplicaciones que hace un año.

- El riesgo de los datos es una de las principales preocupaciones de los primeros usuarios de aplicaciones genAI, ya que el uso compartido de código fuente propietario con aplicaciones genAI representa el 46% de todas las violaciones de la Política de datos.

- La adopción de controles de seguridad para habilitar de forma segura las aplicaciones genAI va en aumento, y más de tres cuartas partes de las organizaciones utilizan políticas de bloqueo/permiso, DLP, coaching de usuarios en directo y otros controles para habilitar las aplicaciones genAI al tiempo que salvaguardan los datos.

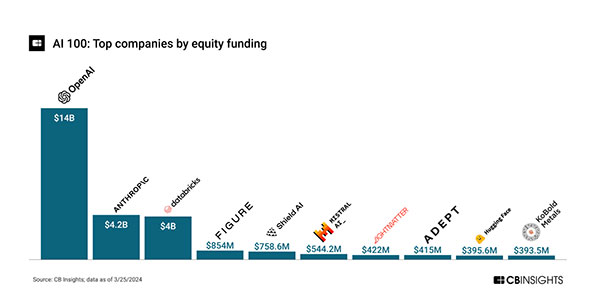

La IA en general ha sido popular y ha atraído una inversión considerable, con una financiación total de más de 28 mil millones de dólares en 240+ acuerdos de capital desde 2020 hasta el 22/03/2024.[1]

Con OpenAI y Anthropic sumando casi dos tercios (64%) de la financiación total, la financiación de la IA está dominada e impulsada por la genAI. Esto refleja el creciente entusiasmo de la genAI desde el lanzamiento de ChatGPT de OpenAI en noviembre de 2022. Además de las startups, se han creado múltiples ETF y fondos mutuos centrados en la IA, lo que indica otro nivel de financiación de los inversores del mercado público. La gran cantidad de inversión proporcionará un viento de cola para la investigación y el desarrollo, los lanzamientos de productos y los riesgos y abusos asociados.

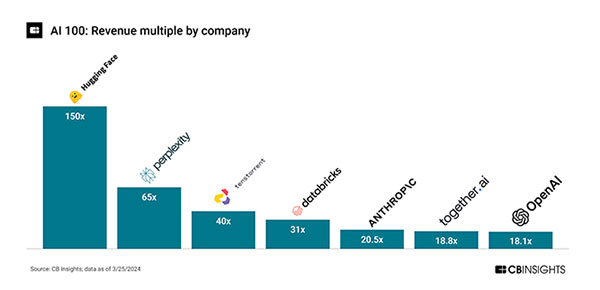

La descomunal relación precio-ventas indica que la ejecución está por detrás de las elevadas expectativas de los inversores. Hugging Face tiene un múltiplo de 150x de una valoración de $4.5B sobre ingresos de $30M y Perplexity un múltiplo de 65x de $520M de valoración sobre ingresos de $8M[1]:

Aunque los ingresos reales están rezagados, la actividad de lanzamiento de productos es alta, lo que indica que todavía estamos en las primeras etapas del ciclo de innovación en IA con una fuerte inversión en investigación y desarrollo. A modo de ejemplo, ha habido 34 lanzamientos de funciones (menores y principales) de ChatGPT desde noviembre de 2022[2], o aproximadamente dos por mes.

Está claro que la genAI será el motor de la inversión en IA a corto plazo e introducirá el riesgo y el impacto más amplios para los usuarios empresariales. Está o estará incluido por defecto en las principales aplicaciones, búsquedas y plataformas dispositivas, con casos de uso como la búsqueda, la edición, el ajuste de estilo/tono y la creación de contenidos. El principal riesgo se deriva de los datos que los usuarios envían a las aplicaciones, incluida la pérdida de datos, el intercambio involuntario de información confidencial y el uso inapropiado de la información (derechos legales) de los servicios de genAI. En la actualidad, se utilizan más los textos (LLM), con su mayor uso Caso, aunque las aplicaciones genAI para vídeo, imágenes y otros medios también son un factor.

Este Informe resume el uso y las tendencias de genAI basándose en los datos anonimizados de los clientes durante los últimos 12 meses, detallando el uso de las aplicaciones, las acciones de los usuarios, las áreas de riesgo y los primeros controles, a la vez que proporciona una guía prescriptiva para los próximos 12 meses.