Desde su aparición generalizada en 2022, la IA generativa ha desencadenado un cambio sísmico en la gestión y la seguridad de los datos. Se estima que uno de cada cuatro empleados utiliza ahora aplicaciones genAI a diario, a menudo sin que su empleador y su equipo de TI lo sepan. Esto plantea preocupaciones, ya que genAI está diseñada con un apetito voraz por consumir datos tanto mundanos como sensibles.

Proteger eficazmente sus datos a medida que la IA generativa se impone es un imperativo estratégico. Descuidar la seguridad de los datos en el ámbito de la IA generativa puede tener consecuencias catastróficas para su empresa. Nuestro Nuevo libro electrónico "Securing Gen AI for Dummies " le equipa con información útil para equilibrar el uso de herramientas genAI en su Organización dentro del marco de prácticas robustas de seguridad de los datos.

IA generativa: Una rápida introducción

En el núcleo de las aplicaciones de IA generativa, como ChatGPT, Jasper y Google Gemini, se encuentran los grandes modelos de lenguaje (LLM) impulsados por redes neuronales avanzadas. Los LLM permiten que las tecnologías de inteligencia artificial (IA), como el aprendizaje automático (ML), el aprendizaje profundo y el procesamiento del lenguaje natural (PLN), interactúen de formas que imitan fielmente el proceso de pensamiento humano y los patrones del lenguaje. En esencia, un LLM utiliza un gran volumen de datos de muestra para entrenar, reconocer e interpretar el lenguaje humano y los conjuntos de datos. Y es la forma en que un LLM recopila y utiliza datos de nueva muestra lo que está en la base misma del desafío de seguridad de datos de una Organización cuando utiliza aplicaciones impulsadas por IA generativa.

Aunque la eficacia y el potencial de innovación que conlleva la IA generativa son seductores, existen importantes preocupaciones en lo que respecta a la seguridad y la ética de los datos.

Las implicaciones de seguridad de la IA generativa

El mayor problema de seguridad de la IA generativa es el riesgo de exponer accidentalmente datos sensibles. Los empleados que utilizan una herramienta de IA generativa pueden darle datos importantes, de propiedad y confidenciales sin darse cuenta de los peligros de una posible exposición. Los empleados que eluden las mejores prácticas de seguridad no hacen más que agravar el problema de la pérdida de datos, junto con el potencial de crear infracciones de derechos de autor y disputas legales.

Al mismo tiempo, un incidente de exposición de datos en una aplicación IA generativa de terceros puede llegar a las aplicaciones principales de una organización conectadas a ellas, lo que puede dar lugar a un robo de datos personales. La IA generativa también ha abierto nuevas vías a riesgos como el raspado de datos, en el que se agregan grandes cantidades de datos sensibles procedentes de diversas fuentes y se hace un uso indebido de ellos. Otra amenaza sutil pero potente es el envenenamiento de datos en el que una herramienta de IA generativa es alimentada intencionadamente con datos maliciosos o inexactos para producir salidas comprometidas o inexactas.

De forma similar al envenenamiento de datos, los modelos predictivos en IN generativa que anticipan resultados futuros a partir de patrones de datos existentes pueden volverse vulnerables a la explotación maliciosa, abriendo vías para la distorsión y el robo de datos. Otra amenaza cibernética para la IA generativa son los ataques de inyección rápida por parte de atacantes que utilizan entradas inteligentes para hacer que los modelos de IA revelen información confidencial o realicen acciones no autorizadas.

La aparición de amenazas impulsadas por la IA representa el lado oscuro de la evolución de la inteligencia artificial. Pero la Organización puede establecer límites operativos para garantizar que la innovación con genAI prospere dentro de un marco sólido de seguridad y privacidad.

La moderna tecnología SSE ayuda a proteger la IA generativa

El concepto de confianza cero es una piedra angular de las tecnologías modernas de ciberseguridad. En el contexto de la IA generativa, esto significa no restringir el uso de estas herramientas, sino garantizar que se supervise cada interacción con ellas.AI Manteniendo la seguridad de los Datos sensibles en primer lugar, esto significa que cada interacción con una herramienta de IA generativa debe ser verificada continuamente para confirmar que no está siendo compartida inadvertidamente con una plataforma de IA generativa, independientemente del tipo de herramienta o plataforma que se esté utilizando.

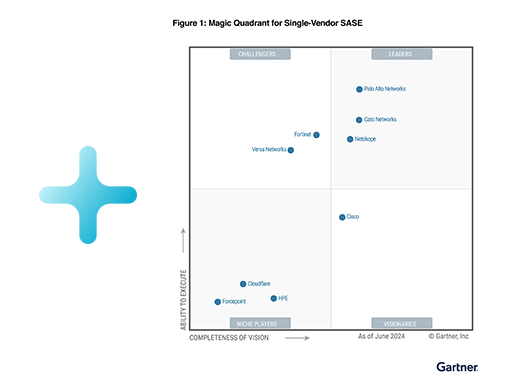

Los principios de confianza cero son la base de una plataforma de servicios de seguridad en el borde (SSE) correctamente diseñada que consolida la seguridad de los datos, SaaS, del navegador y de las aplicaciones privadas en una plataforma unificada basada en la nube. SaaS Las soluciones de seguridad como el Broker de seguridad de acceso a la nube (CASBs) son un componente crítico de una Plataforma SSE que proporcionan una visibilidad profunda de los peligros que acechan dentro de los servicios en la nube y SaaS, incluyendo las vulnerabilidades potenciales con nuevas aplicaciones de IA generativa. Estas soluciones no sólo identifican las aplicaciones de IA generativa en uso, sino también los riesgos asociados, las preocupaciones sobre la protección de datos, los comportamientos de los usuarios y las implicaciones para el cumplimiento de la normativa, lo que ayuda a la Organización a tomar decisiones informadas sobre la aplicación de la seguridad, adaptando sus protocolos de seguridad para hacer frente a amenazas específicas. La solución de seguridad SaaS de Netskope, líder del sector, aprovecha el poder de la IA generativa para el descubrimiento rápido de aplicaciones y la categorización de riesgos, proporcionando información avanzada sobre los riesgos de las aplicaciones, la postura de seguridad y el comportamiento.

Mientras su Organización explora el potencial de la IA generativa, tenga en cuenta que dedicarse a esta tecnología es similar a criar a un niño brillante, inquisitivo y lleno de posibilidades ilimitadas. Exige una orientación cuidadosa, asegurando que cada interacción sea segura y esté bien informada, fomentando un desarrollo saludable en cada paso del camino. Si desea una orientación detallada sobre cómo puede proceder para proteger la IA Generativa en su empresa, descargue una copia gratuita de nuestro nuevo libro electrónico para principiantes "Securing Generative AI for Dummies".

Atrás

Atrás

Lea el blog

Lea el blog