Depuis son émergence en 2022, l'IA générative a déclenché un changement radical dans la gestion et la sécurité des données. On estime qu'un employé sur quatre utilise aujourd'hui quotidiennement des applications de genAI, souvent à l'insu de son employeur et de son équipe informatique. Cela soulève des inquiétudes, car la genAI est conçue avec un appétit vorace pour consommer des données banales et sensibles.

La sécurisation efficace de vos données face à la montée en puissance de la genAI est un impératif stratégique. Négliger la sécurité des données dans le cadre de la genAI peut avoir des conséquences catastrophiques pour votre entreprise. Notre nouvel ebook "Securing Gen AI for Dummies" vous fournit des informations utiles pour équilibrer l'utilisation des outils de genAI dans votre organisation dans le cadre de pratiques robustes de sécurité des données.

Gen AI: Une introduction rapide

Au cœur des applications de genAI, telles que ChatGPT, Jasper et Google Gemini, se trouvent de grands modèles de langage (LLM) alimentés par des réseaux neuronaux avancés. Les LLM permettent aux technologies d'intelligence artificielle (IA), telles que l'apprentissage machine (ML), l'apprentissage profond et le traitement du langage naturel (NLP), d'interagir d'une manière qui imite étroitement le processus de pensée et les modèles de langage humains. À la base, un LLM utilise un grand volume d'échantillons de données pour former, reconnaître et interpréter le langage humain et les ensembles de données. Et c'est la façon dont un LLM recueille et utilise de nouveaux échantillons de données qui est à la base même du défi de la sécurité des données d'une organisation lorsqu'elle utilise des applications alimentées par la genAI.

Si l'efficacité et le potentiel d'innovation de la genAI sont séduisants, la sécurité des données et l'éthique suscitent de vives inquiétudes.

Les implications de la genAI en matière de sécurité

Le principal problème de sécurité que pose la genAI est le risque d'exposition accidentelle de données sensibles. Les employés qui utilisent un outil de genAI peuvent lui fournir des données importantes, exclusives et confidentielles sans se rendre compte des dangers d'une éventuelle exposition. Les employés qui contournent les meilleures pratiques en matière de sécurité ne font qu'exacerber le problème de la perte de données, sans compter le risque de violation des droits d'auteur et de litiges juridiques.

Dans le même temps, un incident d'exposition de données dans une application genAI tierce peut atteindre les applications centrales d'une organisation qui y sont connectées, entraînant un vol de propriété intellectuelle. La GenAI a également ouvert de nouvelles voies pour les risques tels que le "scraping" de données, où de grandes quantités de données sensibles sont agrégées à partir de diverses sources et utilisées à mauvais escient. Une autre menace subtile mais puissante est l'empoisonnement des données, où un outil de genAI est intentionnellement alimenté en données malveillantes ou inexactes pour produire des résultats compromis ou inexacts.

À l'instar de l'empoisonnement des données, les modèles prédictifs de la genAI qui anticipent les résultats futurs à partir de modèles de données existants peuvent devenir vulnérables à une exploitation malveillante, ouvrant la voie à la distorsion et au vol de données. Une autre cybermenace pour l'IA générique est l'attaque par injection rapide de la part d'attaquants qui utilisent des données intelligentes pour amener les modèles d'IA à révéler des informations sensibles ou à prendre des mesures non autorisées.

L'émergence de menaces fondées sur l'IA représente le côté obscur de l'évolution de la genAI. Mais les organisations peuvent fixer des limites opérationnelles pour s'assurer que l'innovation avec la genAI s'épanouit dans un cadre solide de sécurité et de protection de la vie privée.

La technologie moderne SSE contribue à sécuriser la genAI

Le concept de confiance zéro est la pierre angulaire des technologies modernes de cybersécurité. Dans le contexte de la genAI, cela signifie qu'il ne faut pas restreindre l'utilisation de ces outils, mais plutôt veiller à ce que chaque interaction avec eux soit contrôlée. En gardant à l'esprit la sécurité des données sensibles, cela signifie que chaque interaction avec un outil de genAI doit être vérifiée en permanence pour confirmer qu'elle n'est pas partagée par inadvertance avec une plateforme de genAI, quel que soit le type d'outil ou de plateforme utilisé.

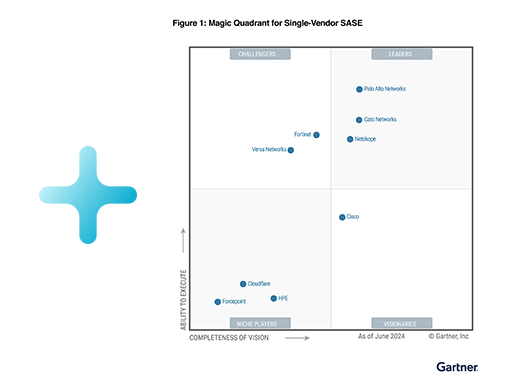

Les principes de confiance zéro sont à la base d'une plateforme de sécurité à la périphérie des services (SSE) correctement architecturée qui consolide la sécurité des données, des SaaS, des navigateurs et des applications privées dans une plateforme unifiée basée sur le cloud. Les solutions de sécurité SaaS telles que les courtiers de sécurité d'accès au nuage (CASB) sont un élément essentiel d'une plateforme SSE qui fournit une visibilité approfondie des dangers cachés dans les services cloud et SaaS, y compris les vulnérabilités potentielles des nouvelles applications genAI. Ces solutions identifient non seulement les apps genAI utilisées, mais aussi les risques associés, les problèmes de protection des données, les comportements des utilisateurs et les implications en matière de conformité, afin d'aider les organisations à prendre des décisions éclairées en matière d'application de la sécurité, en adaptant leurs protocoles de sécurité pour faire face à des menaces spécifiques. La solution de sécurité SaaS de Netskope, leader sur le marché, exploite la puissance de la genAI pour la découverte rapide d'applications et la catégorisation des risques, ce qui permet d'obtenir des informations avancées sur les risques, la posture de sécurité et le comportement des applications.

Alors que votre organisation explore le potentiel de l'IA générative, gardez à l'esprit que s'engager dans cette technologie est similaire à l'éducation d'un enfant brillant, curieux et aux possibilités illimitées. Elle exige un accompagnement attentif, garantissant que chaque interaction est à la fois sûre et bien informée, et favorisant un développement sain à chaque étape. Pour obtenir des conseils détaillés sur la manière de sécuriser l'IA générative dans votre entreprise, téléchargez une copie gratuite de notre dernier livre électronique "Securing Generative AI for Dummies" (Sécuriser l'IA générative pour les nuls).

Retour

Retour

Lire le blog

Lire le blog